Tudo o que Você Precisa para Gerenciar Tráfego de IA

Um gateway AISIX de nível de produção, alimentado por Rust, projetado para desempenho, governança e observabilidade.

Alta Performance

Extremamente Rápido, Construído com Rust

O plano de dados nativo em Rust oferece sobrecarga de proxy sub-milissegundo com pegada de memória mínima. Lide com milhões de requisições por segundo sem esforço.

Governança Unificada

Uma API, Todos os Seus LLMs

Gerencie todos os seus provedores de LLM por meio de uma única API compatível com OpenAI. Configuração centralizada, autenticação e aplicação de políticas em todo o seu stack de IA.

Balanceamento de Carga Inteligente

Balanceamento de Carga Multi-LLM

Distribua dinamicamente o tráfego entre vários provedores de LLM com base na latência, custo e disponibilidade. Weighted round-robin, least-connections e estratégias personalizadas.

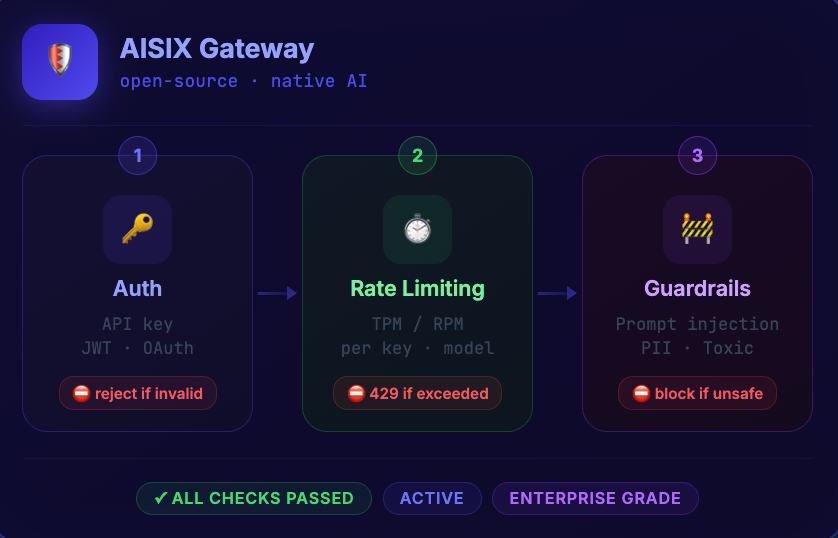

Limitação de Taxa Precisa

Limitação de Taxa de Tokens e Requisições

Limitação de taxa detalhada por tokens, requisições ou dimensões personalizadas. Políticas por consumidor, por rota e em todo o cluster para controlar custos e evitar abusos.

Proteção de Segurança

Segurança de Nível Empresarial

Proteja seu pipeline de IA com detecção de injeção de prompt, moderação de conteúdo, redação de PII e log de auditoria abrangente para conformidade regulatória.

Observabilidade Rica

Observabilidade Full-Stack

Rastreie cada token, monitore as distribuições de latência e analise os padrões de tráfego em tempo real. Integração nativa com Prometheus, Grafana e ClickHouse.

Arquitetura Cloud-Native de

Nível de Produção

A separação entre Plano de Controle e Plano de Dados garante alta escalabilidade, atualizações com zero downtime e confiabilidade de nível empresarial.

Plano de Dados Stateless

Escalável horizontalmente com estado zero — adicione ou remova nós instantaneamente sem migração de dados.

Configuração Baseada em etcd

Gerenciamento de configuração centralizado com propagação em tempo real e recursos de hot-reload.

Separação de Preocupações

O Plano de Controle lida com o gerenciamento; o Plano de Dados lida com o tráfego. Escalonamento e atualizações independentes.

Implante em Minutos, Não Semanas

API compatível com OpenAI. Pronta para produção desde o primeiro dia.

Segurança de nível empresarial incorporada em cada requisição

- Limitação de taxa TPM / RPM — limite de tokens por minuto e requisições por minuto por chave e por modelo

- Guardrails — bloqueie injeção de prompt, vazamento de PII e conteúdo tóxico antes que cheguem ao modelo

- Controle de acesso por chave — restrinja quais modelos cada chave de API pode chamar

- Limites de simultaneidade — evite que um único consumidor monopolize a capacidade

Mais de 100 Provedores de LLM, Um Único Gateway

Conecte-se a qualquer grande provedor de LLM por meio de uma interface unificada e compatível com OpenAI. Sem vendor lock-in, nunca.

Os Melhores Planos de Preços

Comece gratuitamente com nosso core de código aberto. Escale para o enterprise quando estiver pronto.

Open Source

Tudo o que você precisa para começar com AISIX

- Conecte mais de 100 provedores de LLM

- Balanceamento de carga + limites RPM/TPM

- Gerenciamento de chaves virtuais

- OpenTelemetry, Prometheus, Jaeger

- Guardrails de modelo

Enterprise

Cloud ou Self-Hosted. Para equipes gerenciando tráfego de IA em escala.

- Inclui todos os recursos de código aberto

- Suporte prioritário + SLAs personalizados

- Orçamentos, equipes e RBAC

- Logs de auditoria e conformidade

- Recursos enterprise completos

Frequently Asked Questions

Common questions from platform engineers evaluating AI gateways.

An AI gateway is a reverse proxy that sits between your applications and LLM providers (OpenAI, Anthropic, Google Gemini, DeepSeek, etc.). It centralizes authentication, load balancing, rate limiting, observability, and security policies for all AI and LLM traffic — similar to how a traditional API gateway manages REST API traffic.

Learn More About AI Gateways

Explore documentation, comparisons, and guides to evaluate AISIX for your AI infrastructure.

AISIX Documentation

Quickstart guides, API references, deployment tutorials, and plugin documentation for the AISIX AI gateway.

View on GitHub

Explore the AISIX source code, file issues, and contribute to the open-source AI gateway project.

AI Gateway Guide (White Paper)

A comprehensive guide to AI gateways: architecture patterns, LLM traffic governance, and production deployment strategies.

AI Gateway vs MCP Gateway vs API Gateway

Understand the differences between AI gateways, MCP gateways, and traditional API gateways — and when to use each.

What Is an AI Gateway?

Deep dive into AI gateway architecture, use cases, and how it fits into your LLM infrastructure stack.

API Gateway Comparison

Compare AISIX against Kong, NGINX, Traefik, Tyk, and other API gateways across features, performance, and pricing.