Tout ce dont vous avez besoin pour Gérer le Trafic IA

Une passerelle AISIX de classe production, propulsée par Rust, conçue pour la performance, la gouvernance et l'observabilité.

Haute Performance

Incroyablement Rapide, Conçue avec Rust

Le plan de données natif en Rust offre un surcoût de proxy inférieur à la milliseconde avec une empreinte mémoire minimale. Gérez des millions de requêtes par seconde sans sourciller.

Gouvernance Unifiée

Une API, Tous Vos LLMs

Gérez tous vos fournisseurs de LLM via une API unique compatible OpenAI. Configuration centralisée, authentification et application des politiques sur l'ensemble de votre pile IA.

Équilibrage de Charge Intelligent

Équilibrage de Charge Multi-LLM

Distribuez dynamiquement le trafic entre plusieurs fournisseurs de LLM en fonction de la latence, du coût et de la disponibilité. Round-robin pondéré, moins de connexions et stratégies personnalisées.

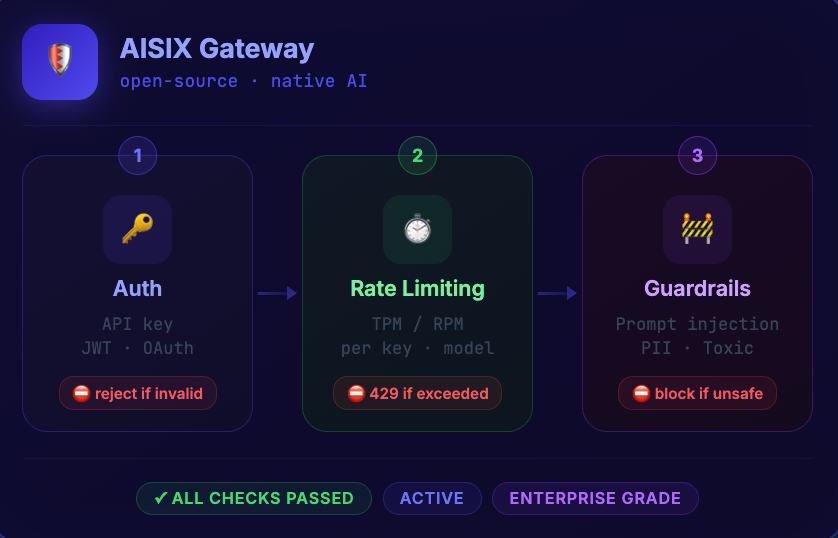

Limitation de Débit Précise

Limitation du Débit de Tokens et de Requêtes

Limitation fine du débit par tokens, requêtes ou dimensions personnalisées. Politiques par consommateur, par route et à l'échelle du cluster pour contrôler les coûts et prévenir les abus.

Garde-fous de Sécurité

Sécurité de Classe Entreprise

Protégez votre pipeline IA avec la détection d'injection de prompt, la modération de contenu, la suppression des PII et une journalisation d'audit complète pour la conformité réglementaire.

Riche Observabilité

Observabilité Full-Stack

Suivez chaque token, surveillez les distributions de latence et analysez les modèles de trafic en temps réel. Intégration native avec Prometheus, Grafana et ClickHouse.

Classe Production,

Architecture Cloud-Native

La séparation du Plan de Contrôle et du Plan de Données garantit une haute évolutivité, des mises à jour sans interruption et une fiabilité au niveau entreprise.

Plan de Données Sans État

Évolutivité horizontale sans état — ajoutez ou supprimez des nœuds instantanément sans migration de données.

Configuration basée sur etcd

Gestion centralisée de la configuration avec propagation en temps réel et capacités de rechargement à chaud.

Séparation des Préoccupations

Le Plan de Contrôle gère l'administration ; le Plan de Données gère le trafic. Évolutivité et mises à jour indépendantes.

Déployez en Quelques Minutes, Pas en Semaines

API compatible OpenAI. Prêt pour la production dès le premier jour.

Sécurité de classe entreprise intégrée à chaque requête

- Limitation de débit TPM / RPM — plafonnez les tokens par minute et les requêtes par minute par clé, par modèle

- Garde-fous — bloquez l'injection de prompt, la fuite de PII et le contenu toxique avant qu'il n'atteigne le modèle

- Contrôle d'accès par clé — restreignez les modèles que chaque clé API peut appeler

- Limites de concurrence — empêchez les consommateurs uniques de monopoliser la capacité

Plus de 100 Fournisseurs de LLM, Une Seule Passerelle

Connectez-vous à n'importe quel fournisseur majeur de LLM via une interface unique compatible OpenAI. Pas de verrouillage fournisseur, jamais.

Les Meilleurs Plans Tarifaires

Commencez gratuitement avec notre cœur open-source. Passez à l'entreprise quand vous êtes prêt.

Open Source

Tout ce dont vous avez besoin pour démarrer avec AISIX

- Connectez plus de 100 fournisseurs de LLM

- Équilibrage de charge + limites RPM/TPM

- Gestion de clés virtuelles

- OpenTelemetry, Prometheus, Jaeger

- Garde-fous de modèle

Enterprise

Cloud ou Auto-hébergé. Pour les équipes gérant le trafic IA à grande échelle.

- Inclut toutes les fonctionnalités open-source

- Support prioritaire + SLAs personnalisés

- Budgets, équipes et RBAC

- Journaux d'audit et conformité

- Fonctionnalités entreprise complètes

Frequently Asked Questions

Common questions from platform engineers evaluating AI gateways.

An AI gateway is a reverse proxy that sits between your applications and LLM providers (OpenAI, Anthropic, Google Gemini, DeepSeek, etc.). It centralizes authentication, load balancing, rate limiting, observability, and security policies for all AI and LLM traffic — similar to how a traditional API gateway manages REST API traffic.

Learn More About AI Gateways

Explore documentation, comparisons, and guides to evaluate AISIX for your AI infrastructure.

AISIX Documentation

Quickstart guides, API references, deployment tutorials, and plugin documentation for the AISIX AI gateway.

View on GitHub

Explore the AISIX source code, file issues, and contribute to the open-source AI gateway project.

AI Gateway Guide (White Paper)

A comprehensive guide to AI gateways: architecture patterns, LLM traffic governance, and production deployment strategies.

AI Gateway vs MCP Gateway vs API Gateway

Understand the differences between AI gateways, MCP gateways, and traditional API gateways — and when to use each.

What Is an AI Gateway?

Deep dive into AI gateway architecture, use cases, and how it fits into your LLM infrastructure stack.

API Gateway Comparison

Compare AISIX against Kong, NGINX, Traefik, Tyk, and other API gateways across features, performance, and pricing.