Alles, was Sie brauchen, um KI-Verkehr zu verwalten

Ein produktionsreifes, Rust-basiertes AISIX-Gateway, das auf Leistung, Governance und Beobachtbarkeit ausgelegt ist.

Hohe Leistung

Blitzschnell, entwickelt mit Rust

Die native Rust-Datenebene bietet einen Proxy-Overhead im Sub-Millisekundenbereich bei minimalem Speicherverbrauch. Verarbeiten Sie Millionen von Anfragen pro Sekunde ohne Probleme.

Einheitliche Governance

Eine API, alle Ihre LLMs

Verwalten Sie alle Ihre LLM-Anbieter über eine einzige, OpenAI-kompatible API. Zentralisierte Konfiguration, Authentifizierung und Richtliniendurchsetzung für Ihren gesamten KI-Stack.

Intelligente Lastverteilung

Multi-LLM-Lastverteilung

Verteilen Sie den Verkehr dynamisch auf mehrere LLM-Anbieter basierend auf Latenz, Kosten und Verfügbarkeit. Gewichtetes Round-Robin, Least-Connections und benutzerdefinierte Strategien.

Präzise Ratenbegrenzung

Token- und Anfragen-Ratenbegrenzung

Feingranulare Ratenbegrenzung nach Token, Anfragen oder benutzerdefinierten Dimensionen. Richtlinien pro Consumer, pro Route und clusterweit zur Kostenkontrolle und Missbrauchsprävention.

Sicherheits-Leitplanken

Enterprise-Grade Sicherheit

Schützen Sie Ihre KI-Pipeline mit Prompt-Injection-Erkennung, Inhaltsmoderation, PII-Schwärzung und umfassender Audit-Protokollierung für die Einhaltung gesetzlicher Vorschriften.

Umfassende Beobachtbarkeit

Full-Stack-Beobachtbarkeit

Verfolgen Sie jedes Token, überwachen Sie Latenzverteilungen und analysieren Sie Verkehrsmuster in Echtzeit. Native Integration mit Prometheus, Grafana und ClickHouse.

Produktionsreif,

Cloud-Native Architektur

Die Trennung von Control Plane und Data Plane gewährleistet hohe Skalierbarkeit, Upgrades ohne Ausfallzeiten und Zuverlässigkeit auf Enterprise-Niveau.

Zustandslose Datenebene

Horizontal skalierbar ohne Zustand — Knoten können ohne Datenmigration sofort hinzugefügt oder entfernt werden.

etcd-basierte Konfiguration

Zentralisiertes Konfigurationsmanagement mit Echtzeit-Propagierung und Hot-Reload-Funktionen.

Trennung der Belange

Die Control Plane übernimmt das Management, die Data Plane den Verkehr. Unabhängige Skalierung und Upgrades.

Bereitstellung in Minuten, nicht Wochen

OpenAI-kompatible API. Vom ersten Tag an produktionsreif.

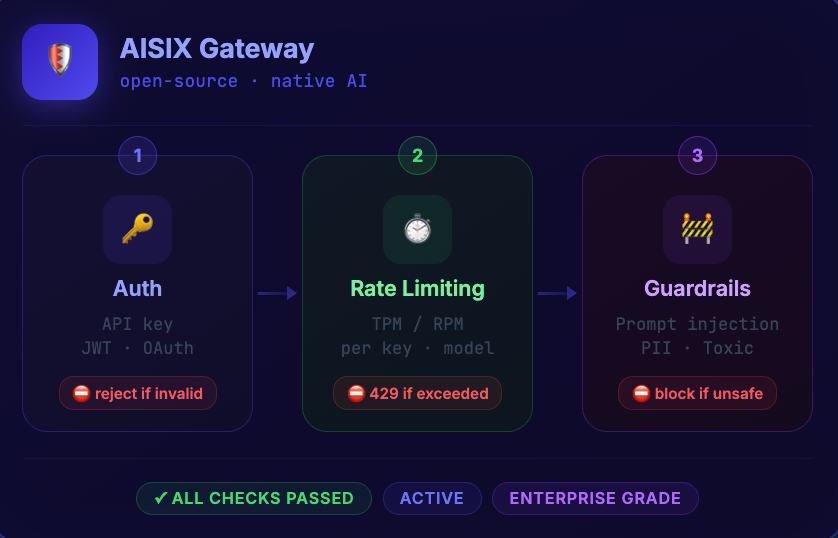

Sicherheit auf Enterprise-Niveau in jede Anfrage integriert

- TPM / RPM Ratenbegrenzung — begrenzen Sie Token pro Minute und Anfragen pro Minute pro Schlüssel und Modell

- Leitplanken — blockieren Sie Prompt-Injection, PII-Lecks und toxische Inhalte, bevor sie das Modell erreichen

- Zugriffskontrolle pro Schlüssel — schränken Sie ein, welche Modelle jeder API-Schlüssel aufrufen darf

- Gleichzeitigkeitslimits — verhindern Sie, dass einzelne Consumer die Kapazität monopolisieren

100+ LLM-Anbieter, ein Gateway

Verbinden Sie sich mit jedem wichtigen LLM-Anbieter über eine einheitliche, OpenAI-kompatible Schnittstelle. Kein Vendor-Lock-in, niemals.

Die besten Preispläne

Starten Sie kostenlos mit unserem Open-Source-Kern. Wechseln Sie zu Enterprise, wenn Sie bereit sind.

Open Source

Alles, was Sie für den Einstieg in AISIX benötigen

- Verbindung zu über 100 LLM-Anbietern

- Lastverteilung + RPM/TPM-Limits

- Virtuelle Schlüsselverwaltung

- OpenTelemetry, Prometheus, Jaeger

- Modell-Leitplanken

Enterprise

Cloud oder selbst gehostet. Für Teams, die KI-Verkehr im großen Stil verwalten.

- Enthält alle Open-Source-Funktionen

- Priorisierter Support + individuelle SLAs

- Budgets, Teams und RBAC

- Audit-Logs und Compliance

- Vollständige Enterprise-Funktionen

Frequently Asked Questions

Common questions from platform engineers evaluating AI gateways.

An AI gateway is a reverse proxy that sits between your applications and LLM providers (OpenAI, Anthropic, Google Gemini, DeepSeek, etc.). It centralizes authentication, load balancing, rate limiting, observability, and security policies for all AI and LLM traffic — similar to how a traditional API gateway manages REST API traffic.

Learn More About AI Gateways

Explore documentation, comparisons, and guides to evaluate AISIX for your AI infrastructure.

AISIX Documentation

Quickstart guides, API references, deployment tutorials, and plugin documentation for the AISIX AI gateway.

View on GitHub

Explore the AISIX source code, file issues, and contribute to the open-source AI gateway project.

AI Gateway Guide (White Paper)

A comprehensive guide to AI gateways: architecture patterns, LLM traffic governance, and production deployment strategies.

AI Gateway vs MCP Gateway vs API Gateway

Understand the differences between AI gateways, MCP gateways, and traditional API gateways — and when to use each.

What Is an AI Gateway?

Deep dive into AI gateway architecture, use cases, and how it fits into your LLM infrastructure stack.

API Gateway Comparison

Compare AISIX against Kong, NGINX, Traefik, Tyk, and other API gateways across features, performance, and pricing.